Comment les robots apprennent à battre les humains au sport

Du tennis de table au football, les robots utilisent l'apprentissage par renforcement et la perception à haute vitesse pour rivaliser avec les athlètes humains – une étape importante qui pourrait transformer la fabrication, les soins de santé et la robotique du quotidien.

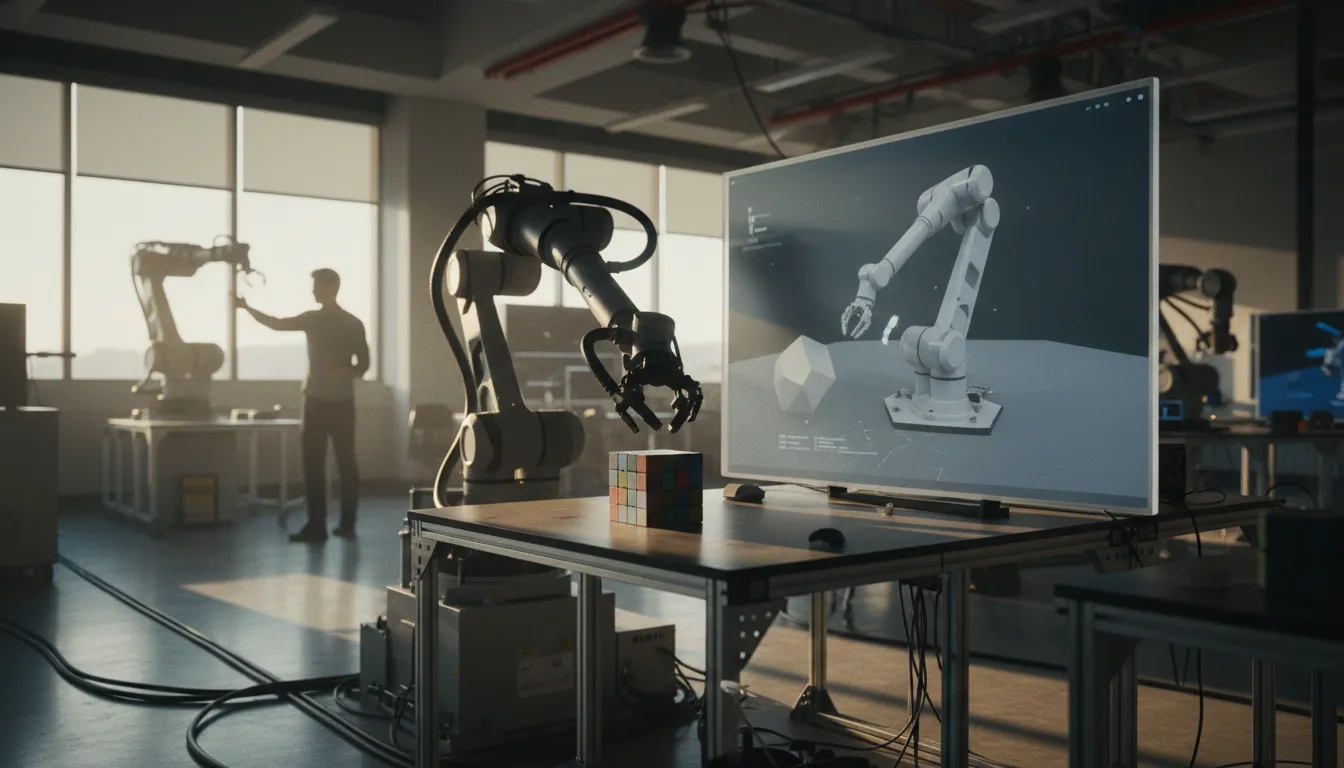

L'athlète robot est arrivé

Pendant des décennies, les machines ont dominé les humains dans les jeux de société et les jeux vidéo. Les échecs sont tombés en 1997, le Go en 2016 et StarCraft en 2019. Mais les sports physiques – où les réflexes au millième de seconde, les adversaires imprévisibles et la physique du monde réel se rencontrent – sont restés une frontière que les robots ne pouvaient pas franchir. Cette barrière est en train de tomber.

Le robot Ace de Sony AI, décrit dans un article de Nature en 2026, est devenu la première machine autonome à vaincre des joueurs de tennis de table de niveau élite selon les règles officielles de la Fédération internationale de tennis de table. Le propre système de tennis de table de Google DeepMind a atteint un niveau amateur-compétitif en 2024. Des robots bipèdes ont appris à jouer au football avec agilité. L'ère de l'athlète robot n'est plus de la science-fiction.

Apprentissage par renforcement : essai, erreur, maîtrise

La technique de base derrière les athlètes robots est l'apprentissage par renforcement (RL). Au lieu de programmer chaque mouvement possible, les ingénieurs laissent le robot apprendre en faisant – en essayant une action, en observant le résultat et en s'ajustant. Au cours de millions d'échanges ou de coups de pied simulés, l'IA découvre des stratégies qu'aucun ingénieur humain ne penserait à coder.

Ace de Sony a entraîné sa politique de contrôle à l'intérieur d'une simulation précise de la physique, puis a transféré ces compétences à un robot physique – un processus que les chercheurs appellent le transfert sim-to-real. L'agent s'est entraîné contre des adversaires synthétiques initialisés à partir d'enregistrements de gameplay humain, ce qui lui a permis d'intérioriser des comportements complexes avant même de toucher une vraie balle.

Google DeepMind a adopté une approche similaire en deux étapes : simulation d'abord pour les fondamentaux, puis affinage avec des données du monde réel afin que le robot puisse s'adapter aux réalités désordonnées du jeu réel. Les deux équipes ont utilisé des architectures hiérarchiques – un contrôleur de haut niveau choisit la stratégie (topspin, slice, placement), tandis qu'un contrôleur de bas niveau exécute les commandes motrices précises.

Voir plus vite que les humains

Les sports physiques exigent une perception à une vitesse surhumaine. Une balle de tennis de table traverse la table en environ 300 millisecondes. La solution d'Ace combine neuf caméras synchronisées basées sur des images avec trois capteurs de vision événementielle – des puces spécialisées qui détectent les changements de lumière à une résolution de microseconde plutôt que de capturer des images complètes. Cela permet au système de suivre la balle à 200 Hz avec une précision millimétrique et de mesurer la rotation jusqu'à 700 fois par seconde.

Le résultat : une latence de bout en bout de seulement 20,2 millisecondes de la perception à l'action, contre environ 230 millisecondes pour un joueur humain d'élite. Le robot ne se contente pas de réagir plus vite – il lit la rotation que les yeux humains ont du mal à détecter, renvoyant avec succès plus de 75 % des balles en rotation jusqu'à 450 radians par seconde.

Au-delà du tennis de table

Le tennis de table est un point de référence, pas la destination. Les robots humanoïdes OP3 de DeepMind ont appris le football agile – dribbler, défendre et se remettre des chutes – en utilisant le RL profond. Une équipe sud-coréenne a construit un robot de curling qui a remporté trois des quatre matchs officiels contre des équipes humaines expertes en s'adaptant aux conditions de glace changeantes en temps réel. La série de robots CUE de Toyota tire des lancers francs au basket-ball avec une précision quasi parfaite.

Chaque sport présente un défi unique : le football exige un équilibre complet du corps, le curling exige une planification stratégique sur plusieurs tours et le basket-ball nécessite un étalonnage précis de la force. Ensemble, ils prouvent que les mêmes principes de RL peuvent se généraliser à des domaines physiques très différents.

Pourquoi c'est important au-delà du terrain de jeu

Les athlètes robots ne sont pas construits pour remplacer les sports humains. Ce sont des bancs d'essai pour l'IA du monde réel. La même perception rapide, le même contrôle adaptatif et la même interaction humaine sûre qui permettent à un robot de renvoyer un service lifté pourraient aider un robot d'entrepôt à manipuler des colis fragiles, un assistant chirurgical à réagir à un saignement inattendu ou un robot domestique à attraper un verre qui tombe.

Peter Stone, scientifique en chef de Sony AI, a qualifié Ace de « la toute première fois qu'il y a eu une démonstration de niveau expert humain de jeu compétitif dans le monde réel dans n'importe quel sport ». Les chercheurs de DeepMind ont fait écho à ce point : leur travail sur le tennis de table est un pas vers des robots qui « effectuent des tâches utiles avec compétence et en toute sécurité » dans les foyers et les lieux de travail.

L'écart entre le robot et l'athlète professionnel reste réel – Ace a perdu ses deux matchs contre les meilleurs joueurs professionnels. Mais la trajectoire est claire : chaque génération apprend plus vite, perçoit davantage et s'adapte mieux. L'athlète robot ne se contente pas de jouer à des jeux – il apprend à naviguer dans le monde physique.