Wie Roboter lernen, Menschen in Sportarten zu schlagen

Von Tischtennis bis Fußball setzen Roboter auf bestärkendes Lernen und Hochgeschwindigkeits-Wahrnehmung, um gegen menschliche Athleten anzutreten – ein Meilenstein, der die Fertigung, das Gesundheitswesen und die Alltagsrobotik verändern könnte.

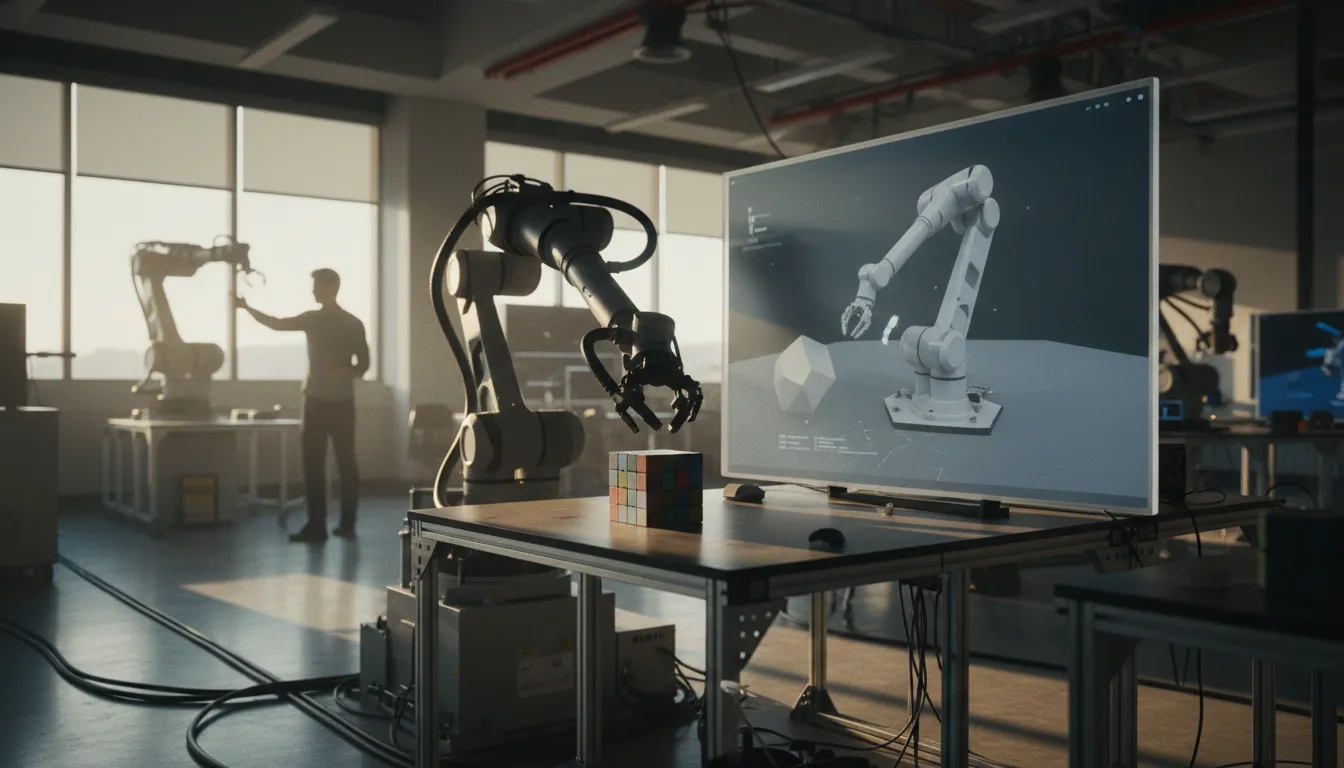

Der Roboter-Athlet ist da

Jahrzehntelang dominierten Maschinen die Menschen in Brett- und Videospielen. Schach fiel 1997, Go 2016 und StarCraft 2019. Aber physische Sportarten – wo Millisekunden-Reflexe, unvorhersehbare Gegner und reale Physik aufeinandertreffen – blieben eine Grenze, die Roboter nicht überschreiten konnten. Diese Barriere bricht nun zusammen.

Der Ace-Roboter von Sony AI, der in einem Nature-Artikel von 2026 beschrieben wurde, war die erste autonome Maschine, die Tischtennisspieler auf Spitzenniveau unter offiziellen Regeln der International Table Tennis Federation besiegte. Das eigene Tischtennissystem von Google DeepMind erreichte 2024 ein wettbewerbsfähiges Amateurniveau. Zweibeinige Roboter haben agilen Fußball gelernt. Das Zeitalter des Roboter-Athleten ist keine Science-Fiction mehr.

Bestärkendes Lernen: Versuch, Irrtum, Meisterschaft

Die Kerntechnik hinter Roboter-Athleten ist das bestärkende Lernen (Reinforcement Learning, RL). Anstatt jede mögliche Bewegung zu programmieren, lassen Ingenieure den Roboter durch Tun lernen – eine Aktion ausprobieren, das Ergebnis beobachten und anpassen. In Millionen von simulierten Ballwechseln oder Tritten entdeckt die KI Strategien, die kein menschlicher Ingenieur zu programmieren in Erwägung ziehen würde.

Sonys Ace trainierte seine Steuerungsrichtlinie in einer physikalisch genauen Simulation und übertrug diese Fähigkeiten dann auf einen physischen Roboter – ein Prozess, den Forscher Sim-to-Real-Transfer nennen. Der Agent übte gegen synthetische Gegner, die aus aufgezeichnetem menschlichem Gameplay initialisiert wurden, wodurch er komplexe Verhaltensweisen verinnerlichen konnte, bevor er jemals einen echten Ball berührte.

Google DeepMind verfolgte einen ähnlichen zweistufigen Ansatz: zuerst Simulation für die Grundlagen, dann Feinabstimmung mit realen Daten, damit sich der Roboter an die chaotischen Realitäten des tatsächlichen Spiels anpassen konnte. Beide Teams verwendeten hierarchische Architekturen – ein High-Level-Controller wählt die Strategie (Topspin, Slice, Platzierung), während ein Low-Level-Controller die präzisen Motorbefehle ausführt.

Schneller sehen als Menschen

Physische Sportarten erfordern Wahrnehmung mit übermenschlicher Geschwindigkeit. Ein Tischtennisball überquert den Tisch in etwa 300 Millisekunden. Die Lösung von Ace kombiniert neun synchronisierte Frame-basierte Kameras mit drei Event-basierten Vision-Sensoren – spezialisierten Chips, die Änderungen im Licht mit Mikrosekunden-Auflösung erkennen, anstatt vollständige Frames zu erfassen. Dadurch kann das System den Ball mit 200 Hz und Millimetergenauigkeit verfolgen und die Drehung mit bis zu 700 Mal pro Sekunde messen.

Das Ergebnis: eine End-to-End-Latenz von nur 20,2 Millisekunden von der Wahrnehmung zur Aktion, verglichen mit etwa 230 Millisekunden für einen menschlichen Spitzenspieler. Der Roboter reagiert nicht nur schneller – er liest auch Drehungen, die menschliche Augen kaum erkennen können, und gibt über 75 % der sich drehenden Bälle mit bis zu 450 Radiant pro Sekunde erfolgreich zurück.

Jenseits von Tischtennis

Tischtennis ist ein Maßstab, nicht das Ziel. Die humanoiden Roboter OP3 von DeepMind lernten agilen Fußball – Dribbeln, Verteidigen und Erholen von Stürzen – mithilfe von Deep RL. Ein südkoreanisches Team baute einen Curling-Roboter, der drei von vier offiziellen Spielen gewann gegen menschliche Expertenteams, indem er sich in Echtzeit an veränderte Eisbedingungen anpasste. Die CUE-Roboter-Serie von Toyota wirft Basketball-Freiwürfe mit nahezu perfekter Genauigkeit.

Jede Sportart stellt eine einzigartige Herausforderung dar: Fußball erfordert Ganzkörperbalance, Curling erfordert strategische Planung über mehrere Runden und Basketball benötigt eine präzise Kraftkalibrierung. Zusammen beweisen sie, dass dieselben RL-Prinzipien über sehr unterschiedliche physische Bereiche verallgemeinert werden können.

Warum es über das Spielfeld hinaus wichtig ist

Roboter-Athleten werden nicht gebaut, um menschliche Sportarten zu ersetzen. Sie sind Testfelder für reale KI. Dieselbe schnelle Wahrnehmung, adaptive Steuerung und sichere Mensch-Roboter-Interaktion, die es einem Roboter ermöglicht, einen Topspin-Aufschlag zurückzugeben, könnte einem Lagerroboter helfen, zerbrechliche Pakete zu handhaben, einem OP-Assistenten, auf unerwartete Blutungen zu reagieren, oder einem Haushaltsroboter, ein fallendes Glas aufzufangen.

Peter Stone, Chief Scientist von Sony AI, nannte Ace „das allererste Mal, dass es eine Demonstration von Wettkampfspielen auf menschlichem Expertenniveau in der realen Welt in irgendeiner Sportart gegeben hat“. Forscher von DeepMind bekräftigten den Punkt: Ihre Tischtennisarbeit sei ein Schritt hin zu Robotern, die „nützliche Aufgaben geschickt und sicher“ in Häusern und an Arbeitsplätzen ausführen.

Die Kluft zwischen Roboter und Profisportler bleibt real – Ace verlor beide Spiele gegen Top-Profispieler. Aber die Entwicklung ist klar: Jede Generation lernt schneller, nimmt mehr wahr und passt sich besser an. Der Roboter-Athlet spielt nicht nur Spiele – er lernt, wie man sich in der physischen Welt zurechtfindet.

Bleib auf dem Laufenden!

Folge uns auf Facebook für die neuesten Nachrichten und Artikel.

Folge uns auf Facebook