Az OpenAI példátlan AI-védőintézkedésekkel kötött megállapodást a Pentagonnal

Az OpenAI megállapodást kötött az Egyesült Államok Védelmi Minisztériumával, hogy AI-modelljeit titkosított hálózatokon telepítse, három nem tárgyalható vörös vonalat rögzítve: nincs tömeges megfigyelés, nincsenek autonóm fegyverek, és nincsenek nagy horderejű automatizált döntések emberi felügyelet nélkül.

Történelmi megállapodás, órák alatt megkötve

2026. február 27-én este Sam Altman, az OpenAI vezérigazgatója a közösségi médián keresztül bejelentette, hogy cége "megállapodást kötött a Hadügyminisztériummal modelljeink titkosított hálózatukban történő telepítéséről". A vállalat által úgy jellemzett megállapodás, amely több védőkorlátot tartalmaz, mint bármely korábbi titkosított AI-telepítési megállapodás, a katonai AI-szerződések rövid történetének egyik legdrámaibb epizódját követően órákon belül aláírásra került.

Az Anthropic bukása, ami előkészítette a terepet

A háttér robbanékony volt. Pete Hegseth védelmi miniszter aznap pénteken korábban a rivális Anthropic AI-laboratóriumot "nemzetbiztonsági ellátási lánc kockázatának" minősítette – ez egy rendkívüli és jogilag vitatott lépés volt, amely gyakorlatilag megtiltotta a katonai vállalkozóknak, hogy üzletet kössenek a vállalattal. Trump elnök ezzel egyidejűleg elrendelte, hogy minden szövetségi ügynökség azonnal hagyja abba az Anthropic szolgáltatásainak használatát.

A vita abból adódott, hogy az Anthropic nem engedte, hogy AI-ját a tömeges belföldi megfigyelés és a teljesen autonóm fegyverek elleni szigorú korlátozások nélkül használják fel. A Pentagon egy "minden törvényes felhasználás" záradék elfogadását követelte, amely széles mérlegelési jogkört biztosít a hadseregnek az AI-modellek telepítésének módjára vonatkozóan. Az Anthropic ezt elutasította. Az OpenAI órákon belül betöltötte a keletkezett űrt.

Az Anthropic a beszállítói lánc kijelölését "jogilag megalapozatlannak" nevezte, és megfogadta, hogy bíróságon támadja meg, azzal érvelve, hogy Hegseth-nek nincs jogi felhatalmazása arra, hogy megtiltsa a vállalkozóknak, hogy üzletet kössenek egy magánvállalattal.

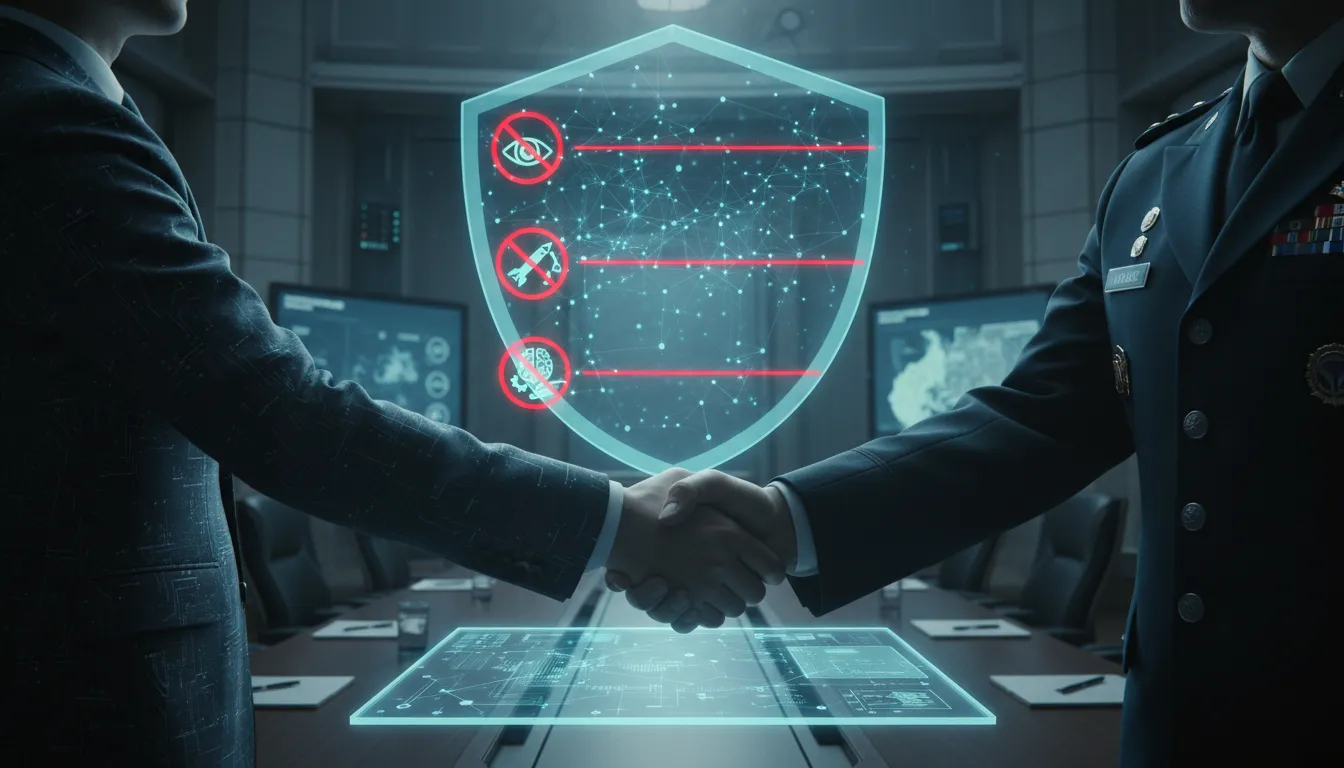

Három vörös vonal, amelyet az OpenAI nem lép át

Az OpenAI-megállapodást az etikai korlátok kifejezett kodifikálása különbözteti meg. Az OpenAI három szigorú korlátozást – az úgynevezett vörös vonalakat – tett közzé, amelyek magában a szerződésben vannak rögzítve, és technikai érvényesítéssel vannak alátámasztva:

- Nincs tömeges belföldi megfigyelés – Az OpenAI technológiája nem használható amerikai állampolgárok nagyméretű megfigyelésére

- Nincsenek autonóm fegyverrendszerek – Az AI-modellek nem használhatók halálos autonóm fegyverek irányítására emberi felügyelet nélkül

- Nincsenek nagy horderejű automatizált döntések – A "szociális kredit" pontozáshoz hasonló rendszerek kifejezetten tilosak

Az OpenAI szerint a Pentagon elfogadta ezeket az elveket, amelyek a hatályos amerikai törvényekben és politikákban is tükröződnek. Lényeges, hogy az OpenAI megtartja az irányítást afelett, hogy mely modelleket telepítik, és hogyan valósítják meg a technikai védőintézkedéseket. A telepítés kizárólag felhőkörnyezetekre korlátozódik – nem peremhálózati eszközökre –, kifejezetten azért, hogy megakadályozzák a halálos autonóm használat lehetőségét a terepen.

200 millió dolláros verseny a katonai AI-ért

A pénzügyi tétek jelentősek. A Pentagon egyenként akár 200 millió dollár értékű megállapodásokat kötött több nagy AI-laboratóriummal, köztük az OpenAI-jal, ami a katonai AI-alkalmazásokban való dominanciáért folytatott strukturált versenynek felel meg. Más vállalatok, köztük az xAI, szintén elfogadták a Pentagon "minden törvényes felhasználás" keretrendszerét az OpenAI által kialkudott védőintézkedések nélkül.

Az OpenAI-megállapodás gyorsasága – amelyet ugyanazon az estén jelentettek be, amikor az Anthropic felkerült a feketelistára – éles figyelmet keltett a megfigyelők és az OpenAI saját alkalmazottai körében. Az OpenAI és a Google munkatársainak egy csoportja nyilvánosan követelte, hogy cégeik egyértelmű "vörös vonalakat" állítsanak fel, mielőtt bármilyen védelmi szerződést aláírnának, figyelmeztetve az AI normalizálására a halálos döntéshozatalban.

Új precedens – vagy kompromisszum?

Altman a megállapodást a felelős AI modelljeként mutatta be a nemzetbiztonsági kontextusban, megjegyezve, hogy a technikai védőintézkedések – beleértve azokat a besorolókat, amelyeket az OpenAI önállóan futtathat és frissíthet – a vállalat számára érdemi felügyeletet biztosítanak még egy titkosított kormányzati környezetben is.

A kritikusok továbbra is szkeptikusak. A megállapodás jelentős bizalmat helyez a szerződéses ígéretekbe és a szabadalmaztatott technikai ellenőrzésekbe, korlátozott külső ellenőrzéssel. De egyelőre az OpenAI-Pentagon megállapodás új mércét állít fel: ez az első alkalom, hogy egy AI-vállalat jogilag kötelező etikai korlátozásokat tárgyalt be egy titkosított amerikai katonai AI-telepítésbe.