OpenAI firma un acuerdo con el Pentágono con salvaguardias de IA sin precedentes

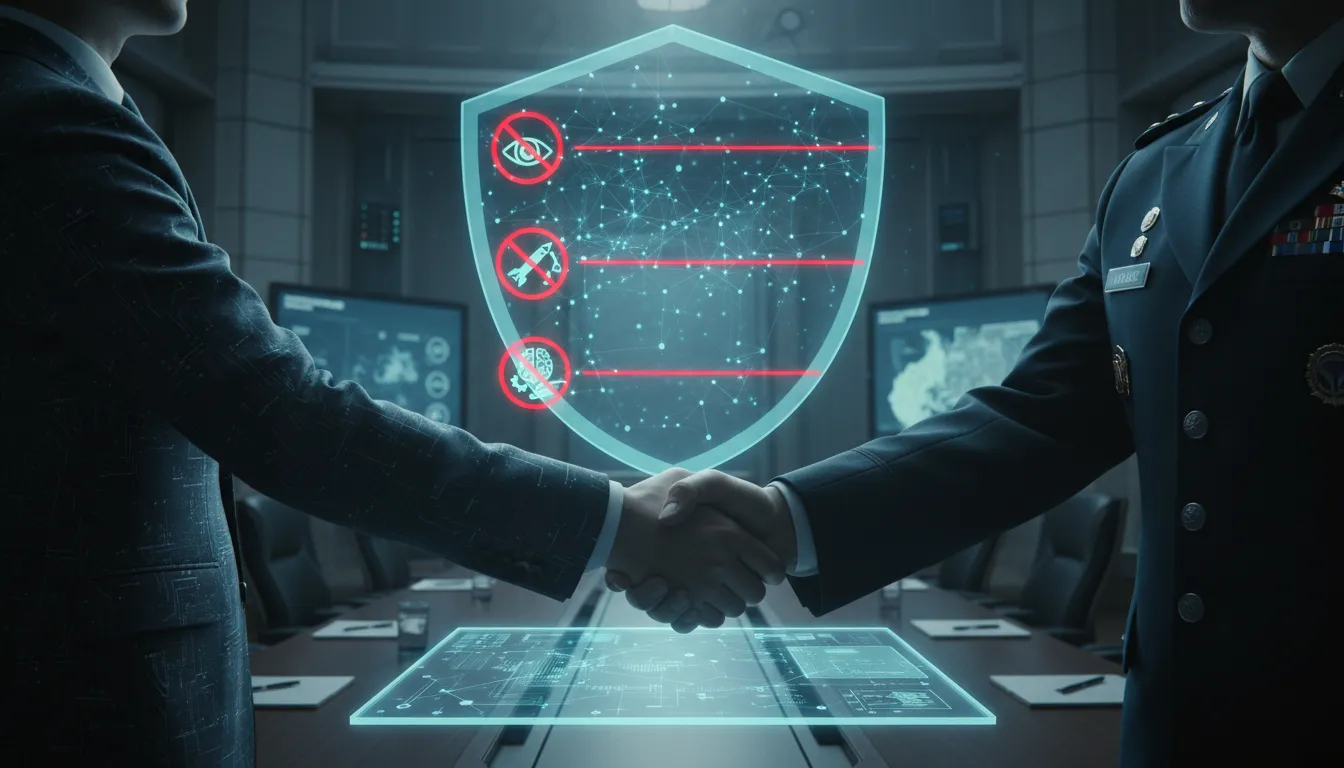

OpenAI ha llegado a un acuerdo con el Departamento de Defensa de EE. UU. para desplegar sus modelos de IA en redes clasificadas, estableciendo tres líneas rojas no negociables: no a la vigilancia masiva, no a las armas autónomas y no a las decisiones automatizadas de alto riesgo sin supervisión humana.

Un acuerdo histórico, alcanzado en horas

En la noche del 27 de febrero de 2026, el CEO de OpenAI, Sam Altman, anunció a través de las redes sociales que su empresa había "llegado a un acuerdo con el Departamento de Guerra para desplegar nuestros modelos en su red clasificada". El acuerdo, descrito por la empresa como portador de más cortafuegos que cualquier acuerdo previo de despliegue de IA clasificada, se firmó pocas horas después de uno de los episodios más dramáticos en la corta historia de la contratación militar de IA.

Las consecuencias de Anthropic que prepararon el terreno

El telón de fondo era explosivo. El Secretario de Defensa, Pete Hegseth, había designado ese mismo viernes al laboratorio rival de IA Anthropic como un "riesgo para la cadena de suministro para la seguridad nacional", una medida extraordinaria y legalmente impugnada que efectivamente prohibía a los contratistas militares hacer negocios con la empresa. El presidente Trump ordenó simultáneamente a todas las agencias federales que cesaran inmediatamente el uso de los servicios de Anthropic.

La disputa surgió de la negativa de Anthropic a permitir que su IA se utilizara sin restricciones firmes contra la vigilancia doméstica masiva y las armas totalmente autónomas. El Pentágono había exigido la aceptación de una cláusula de "todo uso legal", que otorgaba a los militares una amplia discreción sobre cómo se podían desplegar los modelos de IA. Anthropic se negó. OpenAI, en cuestión de horas, ocupó ese vacío.

Anthropic calificó la designación de la cadena de suministro como "jurídicamente insostenible" y prometió impugnarla ante los tribunales, argumentando que Hegseth carece de la autoridad legal para prohibir a los contratistas hacer negocios con una empresa privada.

Tres líneas rojas que OpenAI no cruzará

Lo que distingue al acuerdo de OpenAI es la codificación explícita de límites éticos. OpenAI publicó tres restricciones estrictas, lo que llama líneas rojas, que están integradas en el propio contrato y respaldadas por la aplicación técnica:

- No a la vigilancia doméstica masiva: la tecnología de OpenAI no se puede utilizar para vigilar a los ciudadanos estadounidenses a gran escala

- No a los sistemas de armas autónomas: los modelos de IA no se pueden utilizar para dirigir armas autónomas letales sin supervisión humana

- No a las decisiones automatizadas de alto riesgo: los sistemas similares a la puntuación de "crédito social" están explícitamente prohibidos

Según OpenAI, el Pentágono aceptó estos principios, que también se reflejan en la legislación y la política estadounidense existentes. Fundamentalmente, OpenAI conserva el control sobre qué modelos se despliegan y cómo se implementan las salvaguardias técnicas. El despliegue se limita a entornos de nube únicamente, no a dispositivos periféricos, específicamente para evitar la posibilidad de un uso letal autónomo en el campo.

Una carrera de 200 millones de dólares por la IA militar

Los intereses financieros son significativos. El Pentágono ha celebrado acuerdos valorados en hasta 200 millones de dólares cada uno con varios laboratorios importantes de IA, incluido OpenAI, en lo que equivale a una competencia estructurada por el dominio en las aplicaciones militares de la IA. Otras empresas, incluida xAI, también han aceptado el marco de "todo uso legal" del Pentágono sin las salvaguardias que negoció OpenAI.

La rapidez del acuerdo de OpenAI, anunciado la misma noche en que Anthropic fue incluida en la lista negra, atrajo la atención de los observadores y de los propios empleados de OpenAI. Un grupo de personal de OpenAI y Google exigió públicamente que sus empresas establecieran líneas rojas claras antes de firmar cualquier contrato de defensa, advirtiendo contra la normalización de la IA en la toma de decisiones letales.

¿Un nuevo precedente o un compromiso?

Altman enmarcó el acuerdo como un modelo para la IA responsable en contextos de seguridad nacional, señalando que las salvaguardias técnicas, incluidos los clasificadores que OpenAI puede ejecutar y actualizar de forma independiente, otorgan a la empresa una supervisión significativa incluso dentro de un entorno gubernamental clasificado.

Los críticos siguen siendo escépticos. El acuerdo deposita una confianza significativa en las promesas contractuales y los controles técnicos patentados, con una verificación externa limitada. Pero por ahora, el acuerdo OpenAI-Pentágono establece un nuevo punto de referencia: la primera vez que una empresa de IA ha negociado restricciones éticas legalmente vinculantes en un despliegue clasificado de IA militar de EE. UU.