OpenAI schließt Pentagon-Deal mit beispiellosen KI-Sicherheitsvorkehrungen

OpenAI hat mit dem US-Verteidigungsministerium eine Vereinbarung zur Bereitstellung seiner KI-Modelle in klassifizierten Netzwerken getroffen und dabei drei nicht verhandelbare rote Linien festgelegt: keine Massenüberwachung, keine autonomen Waffen und keine hochriskanten automatisierten Entscheidungen ohne menschliche Aufsicht.

Ein historisches Abkommen, in Stunden geschlossen

Am Abend des 27. Februar 2026 gab OpenAI-CEO Sam Altman über soziale Medien bekannt, dass sein Unternehmen "eine Vereinbarung mit dem Kriegsministerium getroffen hat, um unsere Modelle in dessen klassifiziertem Netzwerk einzusetzen". Der Deal, der vom Unternehmen als mit mehr Schutzmaßnahmen als jede frühere Vereinbarung über den Einsatz klassifizierter KI versehen beschrieben wurde, wurde innerhalb weniger Stunden nach einer der dramatischsten Episoden in der kurzen Geschichte der militärischen KI-Auftragsvergabe unterzeichnet.

Der Anthropic-Fallout, der die Bühne bereitete

Der Hintergrund war brisant. Verteidigungsminister Pete Hegseth hatte bereits an diesem Freitag das rivalisierende KI-Labor Anthropic als "Lieferkettenrisiko für die nationale Sicherheit" eingestuft – ein außergewöhnlicher und rechtlich umstrittener Schritt, der Militärunternehmen faktisch daran hinderte, Geschäfte mit dem Unternehmen zu tätigen. Präsident Trump ordnete gleichzeitig an, dass alle Bundesbehörden die Nutzung der Dienste von Anthropic unverzüglich einstellen.

Der Streit rührte von Anthropic's Weigerung her, seine KI ohne feste Beschränkungen gegen inländische Massenüberwachung und vollautonome Waffen einsetzen zu lassen. Das Pentagon hatte die Akzeptanz einer "all lawful use"-Klausel gefordert, die dem Militär einen breiten Ermessensspielraum bei der Bereitstellung von KI-Modellen einräumt. Anthropic lehnte ab. OpenAI sprang innerhalb weniger Stunden in die Bresche.

Anthropic bezeichnete die Einstufung als Lieferkettenrisiko als "rechtlich unhaltbar" und kündigte an, sie vor Gericht anzufechten, da Hegseth nicht die rechtliche Befugnis habe, Unternehmen daran zu hindern, Geschäfte mit einem privaten Unternehmen zu tätigen.

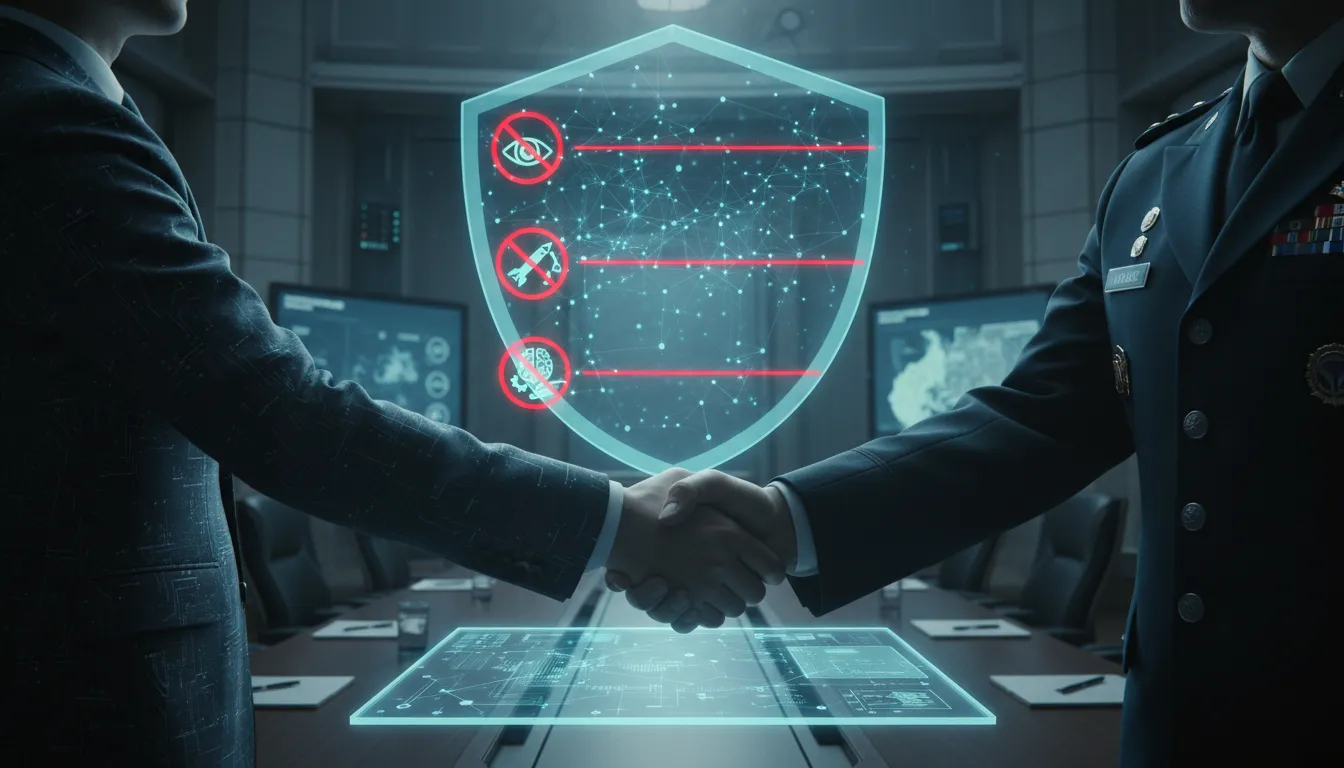

Drei rote Linien, die OpenAI nicht überschreiten wird

Was den OpenAI-Deal auszeichnet, ist die explizite Kodifizierung ethischer Grenzen. OpenAI veröffentlichte drei harte Beschränkungen – was es als rote Linien bezeichnet –, die im Vertrag selbst verankert und durch technische Durchsetzung untermauert sind:

- Keine inländische Massenüberwachung – OpenAI-Technologie darf nicht zur großflächigen Überwachung amerikanischer Bürger eingesetzt werden

- Keine autonomen Waffensysteme – KI-Modelle dürfen nicht zur Steuerung tödlicher autonomer Waffen ohne menschliche Aufsicht verwendet werden

- Keine hochriskanten automatisierten Entscheidungen – Systeme, die einem "Social Credit"-Scoring ähneln, sind ausdrücklich verboten

Laut OpenAI stimmte das Pentagon diesen Grundsätzen zu, die sich auch in bestehenden US-Gesetzen und -Richtlinien widerspiegeln. Entscheidend ist, dass OpenAI die Kontrolle darüber behält, welche Modelle eingesetzt werden und wie technische Schutzmaßnahmen implementiert werden. Der Einsatz ist auf Cloud-Umgebungen beschränkt – nicht auf Edge-Geräte –, insbesondere um die Möglichkeit eines autonomen tödlichen Einsatzes im Feld zu verhindern.

Ein 200-Millionen-Dollar-Rennen um militärische KI

Die finanziellen Einsätze sind beträchtlich. Das Pentagon hat Vereinbarungen im Wert von bis zu 200 Millionen Dollar pro Stück mit mehreren großen KI-Labors, darunter OpenAI, getroffen, was auf einen strukturierten Wettbewerb um die Vorherrschaft bei militärischen KI-Anwendungen hinausläuft. Andere Unternehmen, darunter xAI, haben ebenfalls den "all lawful use"-Rahmen des Pentagons ohne die von OpenAI ausgehandelten Schutzmaßnahmen akzeptiert.

Die Geschwindigkeit des OpenAI-Deals – der am selben Abend angekündigt wurde, an dem Anthropic auf die schwarze Liste gesetzt wurde – erregte die Aufmerksamkeit von Beobachtern und den eigenen Mitarbeitern von OpenAI. Eine Gruppe von Mitarbeitern von OpenAI und Google forderte öffentlich, dass ihre Unternehmen klare "rote Linien" festlegen, bevor sie Verteidigungsaufträge unterzeichnen, und warnte vor der Normalisierung von KI bei tödlichen Entscheidungen.

Ein neuer Präzedenzfall – oder ein Kompromiss?

Altman bezeichnete den Deal als Modell für verantwortungsvolle KI im nationalen Sicherheitskontext und wies darauf hin, dass die technischen Schutzmaßnahmen – einschließlich Klassifikatoren, die OpenAI unabhängig ausführen und aktualisieren kann – dem Unternehmen auch in einem klassifizierten Regierungsumfeld eine sinnvolle Aufsicht ermöglichen.

Kritiker bleiben skeptisch. Die Vereinbarung setzt großes Vertrauen in vertragliche Zusagen und proprietäre technische Kontrollen mit begrenzter externer Überprüfung. Aber vorerst setzt der OpenAI-Pentagon-Deal einen neuen Maßstab: das erste Mal, dass ein KI-Unternehmen rechtlich bindende ethische Beschränkungen in eine klassifizierte US-Militär-KI-Bereitstellung verhandelt hat.

Bleib auf dem Laufenden!

Folge uns auf Facebook für die neuesten Nachrichten und Artikel.

Folge uns auf Facebook