OpenAI podpísala dohodu s Pentagónom s bezprecedentnými bezpečnostnými opatreniami pre AI

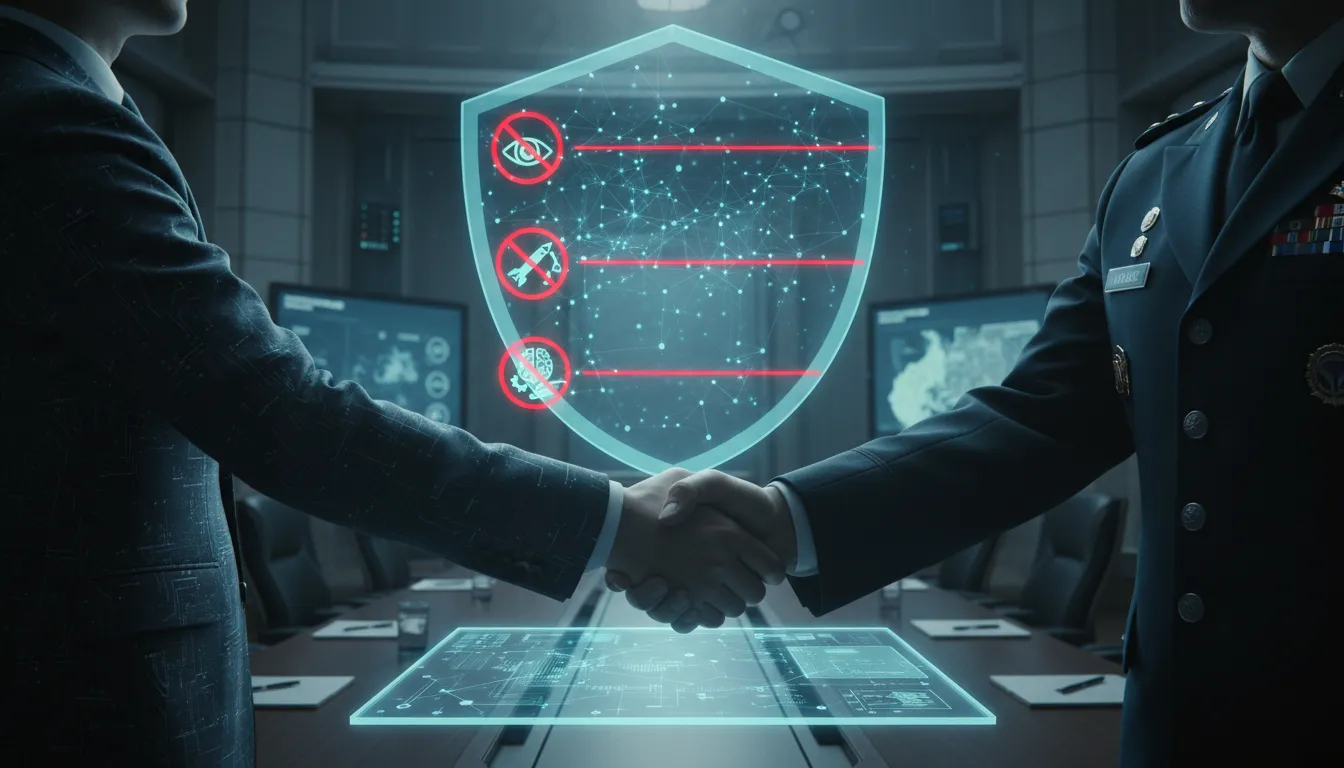

OpenAI uzavrela dohodu s Ministerstvom obrany USA o nasadení svojich modelov AI v utajovaných sieťach, pričom stanovila tri neprekročiteľné hranice – žiadne masové sledovanie, žiadne autonómne zbrane a žiadne automatizované rozhodnutia s vysokými stávkami bez ľudského dohľadu.

Historická dohoda, uzavretá v priebehu hodín

Večer 27. februára 2026 generálny riaditeľ OpenAI Sam Altman oznámil prostredníctvom sociálnych médií, že jeho spoločnosť „dosiahla dohodu s Ministerstvom obrany o nasadení našich modelov v ich utajovanej sieti.“ Dohoda, ktorú spoločnosť opísala ako dohodu s viac bezpečnostnými zábranami ako ktorákoľvek predchádzajúca dohoda o nasadení utajovanej AI, bola podpísaná v priebehu niekoľkých hodín po jednej z najdramatickejších epizód v krátkej histórii vojenských zákaziek na AI.

Pád Anthropic, ktorý pripravil pôdu

Pozadie bolo výbušné. Minister obrany Pete Hegseth v ten piatok predtým označil konkurenčné laboratórium AI Anthropic za „riziko dodávateľského reťazca pre národnú bezpečnosť“ – čo bol mimoriadny a právne sporný krok, ktorý fakticky zakázal vojenským dodávateľom obchodovať so spoločnosťou. Prezident Trump súčasne nariadil všetkým federálnym agentúram, aby okamžite prestali používať služby spoločnosti Anthropic.

Spor pramenil z odmietnutia spoločnosti Anthropic povoliť používanie jej AI bez pevných obmedzení proti masovému domácemu sledovaniu a plne autonómnym zbraniam. Pentagón požadoval prijatie klauzuly „všetko zákonné použitie“, ktorá by armáde poskytla širokú diskrečnú právomoc nad tým, ako by sa mohli modely AI nasadiť. Anthropic to odmietol. OpenAI v priebehu niekoľkých hodín vstúpila do medzery.

Anthropic označil označenie dodávateľského reťazca za „právne neopodstatnené“ a zaviazal sa ho napadnúť na súde, pričom argumentoval tým, že Hegseth nemá zákonnú právomoc zakázať dodávateľom obchodovať so súkromnou spoločnosťou.

Tri červené čiary, ktoré OpenAI neprekročí

To, čo odlišuje dohodu OpenAI, je explicitná kodifikácia etických limitov. OpenAI zverejnila tri prísne obmedzenia – to, čo nazýva červené čiary – ktoré sú zakotvené v samotnej zmluve a podporené technickým presadzovaním:

- Žiadne masové domáce sledovanie – technológia OpenAI sa nesmie používať na rozsiahle sledovanie amerických občanov

- Žiadne autonómne zbraňové systémy – modely AI sa nesmú používať na riadenie smrtiacich autonómnych zbraní bez ľudského dohľadu

- Žiadne automatizované rozhodnutia s vysokými stávkami – systémy podobné „sociálnemu kreditu“ sú výslovne zakázané

Podľa OpenAI Pentagón s týmito zásadami súhlasil, čo sa odráža aj v existujúcich zákonoch a politikách USA. Zásadné je, že OpenAI si ponecháva kontrolu nad tým, ktoré modely sa nasadia a ako sa implementujú technické záruky. Nasadenie je obmedzené iba na cloudové prostredia – nie na koncové zariadenia – konkrétne preto, aby sa predišlo možnosti autonómneho smrtiaceho použitia v teréne.

Preteky o vojenskú AI za 200 miliónov dolárov

Finančné stávky sú značné. Pentagón uzavrel dohody v hodnote až 200 miliónov dolárov s viacerými významnými laboratóriami AI, vrátane OpenAI, v tom, čo predstavuje štruktúrovanú súťaž o dominanciu vo vojenských aplikáciách AI. Ďalšie spoločnosti, vrátane xAI, tiež prijali rámec Pentagónu „všetko zákonné použitie“ bez bezpečnostných opatrení, ktoré vyjednala OpenAI.

Rýchlosť dohody OpenAI – oznámená v ten istý večer, keď bola Anthropic zaradená na čiernu listinu – upútala pozornosť pozorovateľov a vlastných zamestnancov OpenAI. Skupina zamestnancov z OpenAI aj Google verejne požadovala, aby ich spoločnosti stanovili jasné „červené čiary“ pred podpísaním akýchkoľvek obranných zmlúv, pričom varovali pred normalizáciou AI pri rozhodovaní o smrti.

Nový precedens – alebo kompromis?

Altman označil dohodu za model zodpovednej AI v kontexte národnej bezpečnosti, pričom poznamenal, že technické záruky – vrátane klasifikátorov, ktoré môže OpenAI spúšťať a aktualizovať nezávisle – poskytujú spoločnosti zmysluplný dohľad aj v utajovanom vládnom prostredí.

Kritici zostávajú skeptickí. Dohoda vkladá značnú dôveru do zmluvných sľubov a proprietárnych technických kontrol s obmedzenou externou verifikáciou. Ale zatiaľ dohoda OpenAI-Pentagón stanovuje nový štandard: prvýkrát, čo spoločnosť zaoberajúca sa AI vyjednala právne záväzné etické obmedzenia do utajovaného nasadenia AI v americkej armáde.