OpenAI podepsala dohodu s Pentagonem s nebývalými zárukami pro AI

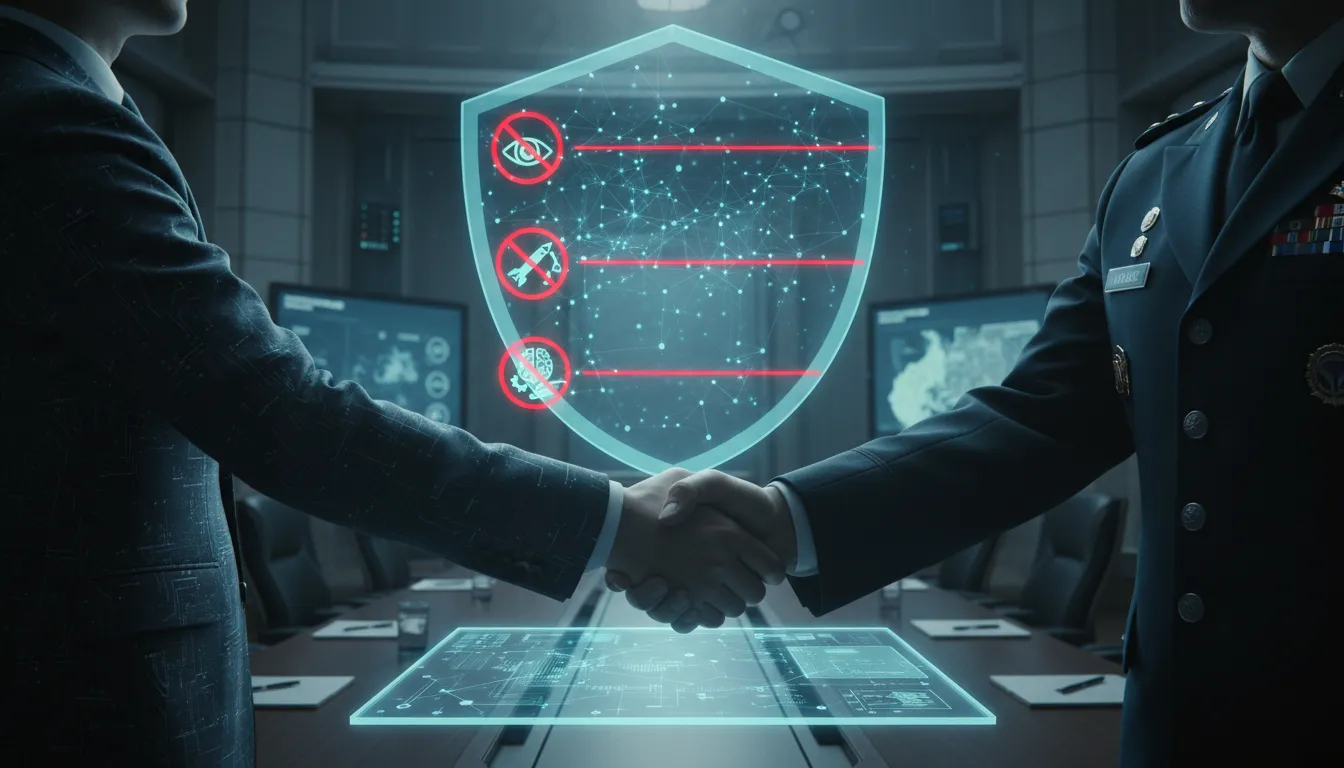

OpenAI uzavřela dohodu s Ministerstvem obrany USA o nasazení svých modelů AI v utajovaných sítích, přičemž stanovila tři neprůstřelné červené linie – žádný masový dohled, žádné autonomní zbraně a žádná automatizovaná rozhodnutí s vysokými sázkami bez lidského dohledu.

Historická dohoda, uzavřená během několika hodin

Večer 27. února 2026 generální ředitel OpenAI Sam Altman oznámil prostřednictvím sociálních médií, že jeho společnost „dosáhla dohody s Ministerstvem války o nasazení našich modelů v jejich utajované síti.“ Dohoda, kterou společnost popsala jako dohodu s více ochrannými prvky než jakákoli předchozí dohoda o nasazení utajované AI, byla podepsána během několika hodin po jedné z nejdramatičtějších epizod v krátké historii vojenských zakázek na AI.

Pád Anthropic, který připravil půdu

Pozadí bylo výbušné. Ministr obrany Pete Hegseth dříve ten pátek označil konkurenční laboratoř AI Anthropic za „riziko dodavatelského řetězce pro národní bezpečnost“ – což je mimořádný a právně sporný krok, který fakticky zakázal vojenským dodavatelům obchodovat s touto společností. Prezident Trump současně nařídil všem federálním agenturám, aby okamžitě přestaly používat služby Anthropic.

Spor pramenil z odmítnutí Anthropic nechat svou AI používat bez pevných omezení proti masovému domácímu dohledu a plně autonomním zbraním. Pentagon požadoval přijetí doložky „veškeré zákonné použití“, která by armádě poskytla širokou volnost v tom, jak by mohly být modely AI nasazeny. Anthropic to odmítl. OpenAI, během několika hodin, vstoupila do mezery.

Anthropic označila označení dodavatelského řetězce za „právně neopodstatněné“ a zavázala se, že jej napadne u soudu, přičemž argumentovala tím, že Hegseth nemá zákonné pravomoci zakázat dodavatelům obchodovat se soukromou společností.

Tři červené linie, které OpenAI nepřekročí

To, co odlišuje dohodu OpenAI, je explicitní kodifikace etických limitů. OpenAI zveřejnila tři tvrdá omezení – to, co nazývá červené linie – která jsou zakotvena v samotné smlouvě a podpořena technickým prosazováním:

- Žádný masový domácí dohled – technologie OpenAI nemůže být použita k rozsáhlému sledování amerických občanů

- Žádné autonomní zbraňové systémy – modely AI nemohou být použity k řízení smrtících autonomních zbraní bez lidského dohledu

- Žádná automatizovaná rozhodnutí s vysokými sázkami – systémy podobné „sociálnímu kreditu“ jsou výslovně zakázány

Podle OpenAI Pentagon s těmito principy souhlasil, což se odráží i ve stávajících zákonech a politikách USA. Zásadní je, že si OpenAI ponechává kontrolu nad tím, které modely jsou nasazeny a jak jsou implementovány technické záruky. Nasazení je omezeno pouze na cloudová prostředí – nikoli na koncová zařízení – konkrétně proto, aby se zabránilo možnosti autonomního smrtícího použití v terénu.

Závod o vojenskou AI za 200 milionů dolarů

Finanční sázky jsou značné. Pentagon uzavřel dohody v hodnotě až 200 milionů dolarů každá s několika významnými laboratořemi AI, včetně OpenAI, v tom, co se rovná strukturované soutěži o dominanci ve vojenských aplikacích AI. Další společnosti, včetně xAI, také přijaly rámec Pentagonu „veškeré zákonné použití“ bez záruk, které si OpenAI vyjednala.

Rychlost dohody OpenAI – oznámená ve stejný večer, kdy byla Anthropic zařazena na černou listinu – přitáhla ostrou pozornost pozorovatelů a vlastních zaměstnanců OpenAI. Skupina zaměstnanců z OpenAI i Googlu veřejně požadovala, aby jejich společnosti stanovily jasné „červené linie“ před podpisem jakýchkoli obranných smluv, a varovala před normalizací AI ve smrtících rozhodovacích procesech.

Nový precedens – nebo kompromis?

Altman označil dohodu za model odpovědné AI v kontextu národní bezpečnosti a poznamenal, že technické záruky – včetně klasifikátorů, které může OpenAI spouštět a nezávisle aktualizovat – dávají společnosti smysluplný dohled i v utajovaném vládním prostředí.

Kritici zůstávají skeptičtí. Dohoda vkládá značnou důvěru do smluvních slibů a proprietárních technických kontrol s omezeným externím ověřením. Ale prozatím dohoda OpenAI-Pentagon stanovuje nový standard: poprvé, kdy si společnost zabývající se AI vyjednala právně závazná etická omezení do utajovaného nasazení AI americké armády.