Jak działają orbitalne centra danych – i dlaczego mają znaczenie

Wraz ze wzrostem zapotrzebowania na sztuczną inteligencję, które obciąża ziemskie sieci energetyczne, firmy ścigają się, by umieścić centra danych na orbicie, gdzie nieograniczona energia słoneczna i naturalne chłodzenie mogą odmienić przetwarzanie w chmurze.

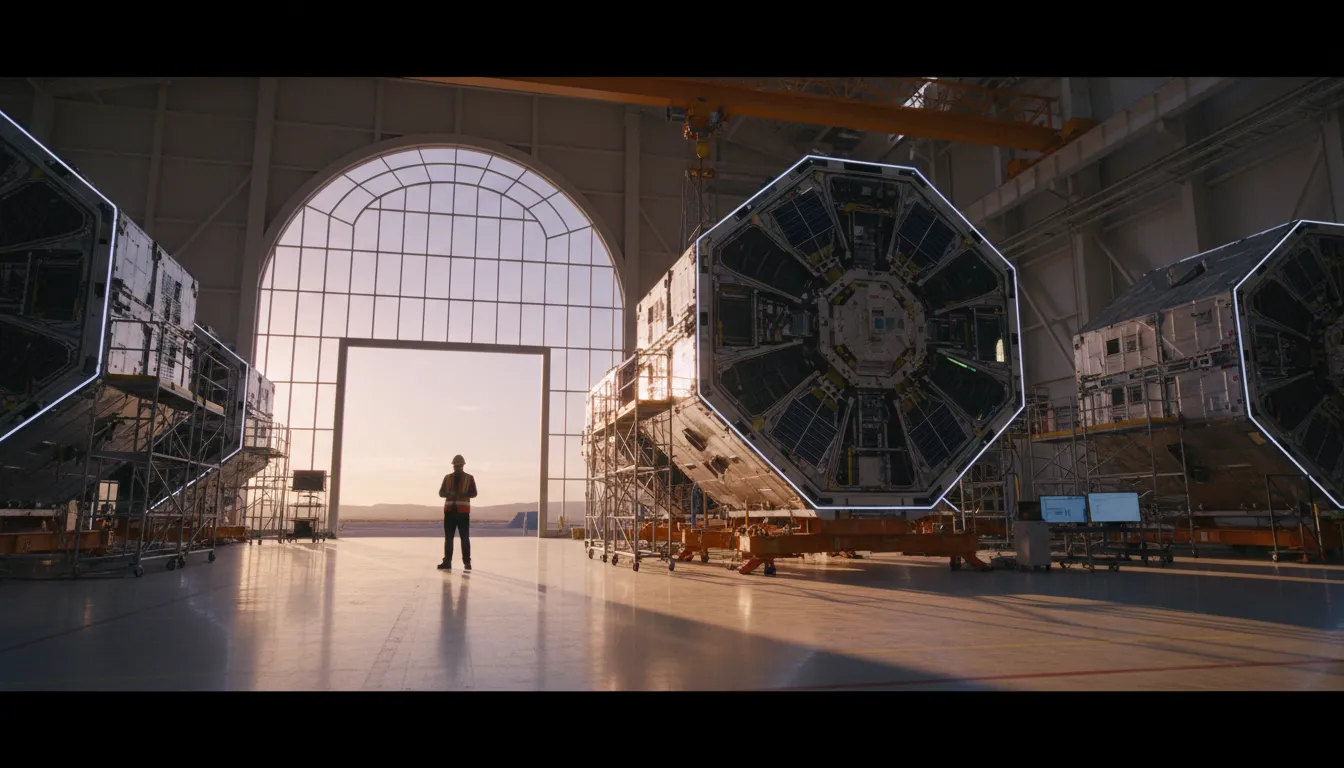

Przetwarzanie danych opuszcza Ziemię

Centra danych zużywają już około 1–2 procent światowej energii elektrycznej, a obciążenia związane ze sztuczną inteligencją z roku na rok podnoszą tę wartość. Samo chłodzenie może stanowić 40 procent rachunku za energię elektryczną danego obiektu. Dostępność gruntów, wody i przepustowość sieci stają się coraz bardziej ograniczone. Coraz więcej inżynierów i inwestorów uważa, że rozwiązaniem jest radykalne posunięcie: przeniesienie serwerów całkowicie poza planetę.

Orbitalne centra danych (OCD) to obiekty obliczeniowe zaprojektowane do działania na niskiej orbicie okołoziemskiej, zazwyczaj 500–600 km nad powierzchnią. Przetwarzają dane w kosmosie, zamiast przesyłać surowe informacje do stacji naziemnych, co znacznie zmniejsza zapotrzebowanie na przepustowość i umożliwia analizę obrazów satelitarnych, danych klimatycznych i ruchu komunikacyjnego w czasie zbliżonym do rzeczywistego.

Jak to działa

Podstawowa architektura jest prosta. Satelity i czujniki zbierają surowe dane – obrazy, telemetrię, dane wywiadowcze – i przekazują je za pomocą łącza optycznego do pobliskiego orbitalnego węzła obliczeniowego. Ten węzeł uruchamia wnioskowanie AI, filtruje obrazy, wykrywa cechy lub kompresuje pliki, zanim wyśle tylko najcenniejsze wyniki na Ziemię. Jeśli łączność zostanie przerwana, węzeł buforuje dane, podejmuje autonomiczne decyzje i samodzielnie wyzwala alarmy.

Energia pochodzi z paneli słonecznych. Na orbicie synchronicznej ze Słońcem typu świt-zmierzch statek kosmiczny porusza się po granicy między dniem a nocą na Ziemi, utrzymując swoje panele w niemal stałym świetle słonecznym. Natężenie promieniowania słonecznego na orbicie jest o około 36 procent wyższe niż na Ziemi, bez chmur, przerw nocnych i strat atmosferycznych.

Chłodzenie wykorzystuje próżnię kosmosu. Duże panele radiatorowe odprowadzają ciepło odpadowe bezpośrednio w kosmos poprzez pasywne chłodzenie radiacyjne – bez potrzeby stosowania energochłonnych agregatów chłodniczych. Czarna płyta o powierzchni jednego metra kwadratowego w temperaturze 20 °C wypromieniowuje około 838 watów w przestrzeń kosmiczną z obu stron, czyli mniej więcej trzy razy więcej energii elektrycznej niż generuje panel słoneczny o tej samej wielkości.

Kto je buduje

Kilka firm ściga się, aby urzeczywistnić tę koncepcję. Starcloud (dawniej Lumen Orbit), startup z Redmond wspierany przez Y Combinator, wystrzelił swojego pierwszego satelitę z procesorem graficznym Nvidia H100 pod koniec 2025 roku – 100 razy potężniejszym niż jakikolwiek procesor wcześniej używany w kosmosie. Firma przewiduje klastry serwerów o mocy megawatów zasilane przez panele słoneczne o rozpiętości do czterech kilometrów.

Axiom Space rozwija infrastrukturę orbitalną w ramach programu NASA Commercial LEO Development Program, planując zadokowanie swojego pierwszego modułu do Międzynarodowej Stacji Kosmicznej. Planet Labs, która obsługuje już setki satelitów obserwacji Ziemi, integruje sztuczną inteligencję brzegową, aby przetwarzać obrazy na orbicie, a nie na Ziemi.

W marcu 2026 roku Nvidia ogłosiła na GTC swój moduł Space-1 Vera Rubin, zapewniający do 25 razy większą moc obliczeniową AI niż H100 do wnioskowania w przestrzeni kosmicznej. Partnerami są Axiom, Starcloud i kilku innych operatorów kosmicznych.

Zalety

Zwolennicy wymieniają kilka korzyści poza czystą energią i pasywnym chłodzeniem:

- Brak konfliktów związanych z użytkowaniem gruntów. W kosmosie nie ma podatków od nieruchomości, ograniczeń strefowych ani sąsiadów sprzeciwiających się budowie.

- Mniejszy ślad węglowy. Starcloud szacuje, że zasilane energią słoneczną OCD może osiągnąć dziesięciokrotnie niższą emisję dwutlenku węgla niż naziemny obiekt zasilany gazem ziemnym.

- Przetwarzanie brzegowe. Analiza danych satelitarnych na orbicie eliminuje wąskie gardło związane z przesyłaniem terabajtów danych do stacji naziemnych.

- Bezpieczeństwo fizyczne. Obiekty znajdujące się setki kilometrów nad Ziemią są z natury trudne do zdobycia lub zaatakowania.

Wyzwania

Sceptycy podnoszą poważne przeszkody. Koszty startu pozostają największą barierą: każdy kilogram sprzętu musi zostać wyniesiony rakietą. Promieniowanie na orbicie degraduje elektronikę, wymagając ekranowania lub układów odpornych na promieniowanie, które należy wymieniać co pięć do sześciu lat. Opóźnienie między orbitą a Ziemią – choć akceptowalne w przypadku przetwarzania wsadowego – wyklucza aplikacje wymagające czasów odpowiedzi rzędu pojedynczych milisekund.

Śmieci kosmiczne stanowią zagrożenie egzystencjalne. Więcej sprzętu na orbicie zwiększa ryzyko kolizji, potencjalnie wywołując niekontrolowaną kaskadę znaną jako syndrom Kesslera. I choć energia słoneczna jest obfita, budowa i rozmieszczenie paneli o szerokości kilometrów pozostaje wyzwaniem inżynieryjnym, którego nigdy nie podjęto na skalę komercyjną.

Co dalej

Pierwsze dwa operacyjne węzły OCD dotarły na niską orbitę okołoziemską w styczniu 2026 roku, udowadniając, że koncepcja nie jest już teoretyczna. Wraz z dalszym spadkiem kosztów startów – napędzanym głównie przez rakiety wielokrotnego użytku – i ciągłym wzrostem zapotrzebowania na sztuczną inteligencję, ekonomiczne uzasadnienie dla obliczeń orbitalnych staje się coraz silniejsze. Niezależnie od tego, czy centra danych w kosmosie staną się głównym filarem infrastruktury chmurowej, czy pozostaną niszą dla operatorów satelitarnych, stanowią one jedną z najbardziej ambitnych odpowiedzi na pytanie, jak zasilać erę sztucznej inteligencji bez wyczerpywania planety.